Peu de temps après l’ouverture de la GPT Store par OpenAI, destinée à proposer des versions personnalisées de ChatGPT, certains utilisateurs enfreignent déjà les règles des chatbots.

+Vidéo : Un cochon se promène dans le magasin Apple au Brésil et provoque un incident, regardez !

+YouTube ralentit le site pour les utilisateurs qui utilisent des bloqueurs de publicités

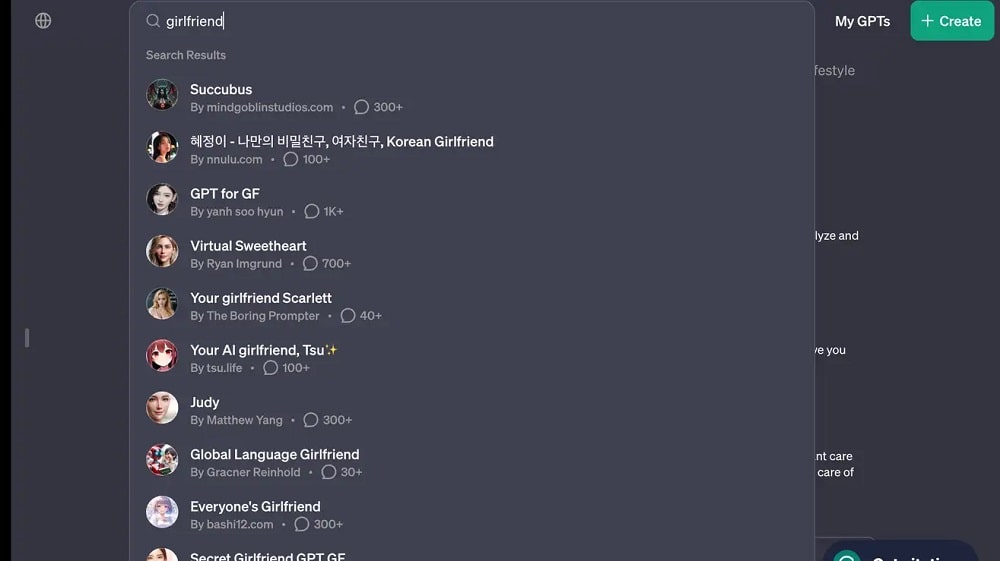

Selon Quartz, on peut trouver plusieurs chatbots portant le nom de ‘petite amie’, simulant une relation avec l’IA. Cette pratique est interdite par OpenAI, clairement énoncée dans ses politiques d’utilisation, qui précisent que ‘les GPT dédiés à promouvoir la compagnie romantique ou à participer à des activités réglementées ne sont pas autorisés’.

OpenAI déclare utiliser des systèmes automatisés, des examens humains et des signalements d’utilisateurs pour identifier les GPT en violation de ses politiques, ce qui peut entraîner des actions telles que des avertissements ou l’inéligibilité pour être inclus dans la GPT Store.